サイバー攻撃とのはてしない戦いに対する新戦力としてのAI活用最前線

2022年5月30日、東京大学次世代知能科学研究センター連続シンポジウムの第9回がオンラインで開催されました。今回のシンポジウムは、「サイバー攻撃の脅威に対抗するセキュリティAI最前線」というテーマで行われました。この記事では4名の登壇者の発表を要約することで、AIを活用したサイバーセキュリティの最前線を紹介します。

防御側が優勢な時もあるサイバーセキュリティ

1人目の登壇者である東京大学生産技術研究所所属の松浦幹太教授は、「情報セキュリティ分野における安全性評価とAI」と題してサイバーセキュリティにおけるAI活用の概要と歴史について発表しました。

はじめに松浦教授は、AI技術の一種である機械学習の応用事例をセキュリティ問題が生じた場合の深刻度に応じて分類しました。Google翻訳のような機械翻訳と各種レコメンデーションシステムは、仮にサイバー攻撃を受けて正しくない解答を出力したとしても、直接的に人命が危険に晒されるわけではありません。対して、自動運転、産業用機械やIoT、フィンテック、工場における異常検知システムなどは、サイバー攻撃によって人命が危険にさらされたり、金銭的被害が生じたりする可能性があります。

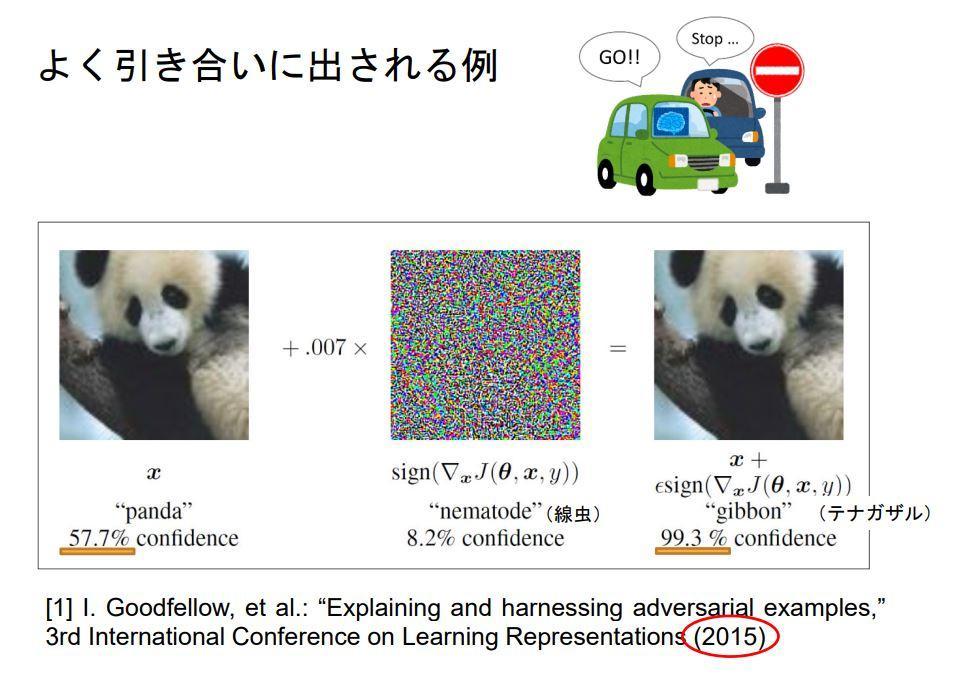

AIの代表的な応用事例である画像認識では、有名なサイバー攻撃事例があります。任意の画像に人間が識別できないノイズを加えると、AIは画像に写ったオブジェクトを誤って認識してしまうのです。例えば、パンダが写った画像にノイズを加えると、AIは(人間にはそう見えないにもかかわらず)テナガザルと認識してしまうのです。

つづいて松浦教授はサイバーセキュリティにおけるAI活用の歴史を振り返る試みとして、検索エンジンを使った調査結果について話しました。サイバーセキュリティにおけるAI活用に関する古い文献は1998年で既に多くのものがあり、近年も4本の解説論文が発表されています。また、2022年開催のIEEE Symposium on Security and Privacyにおいて採録された解説論文(SoK論文)の1本がAI関連のものとわかりました。

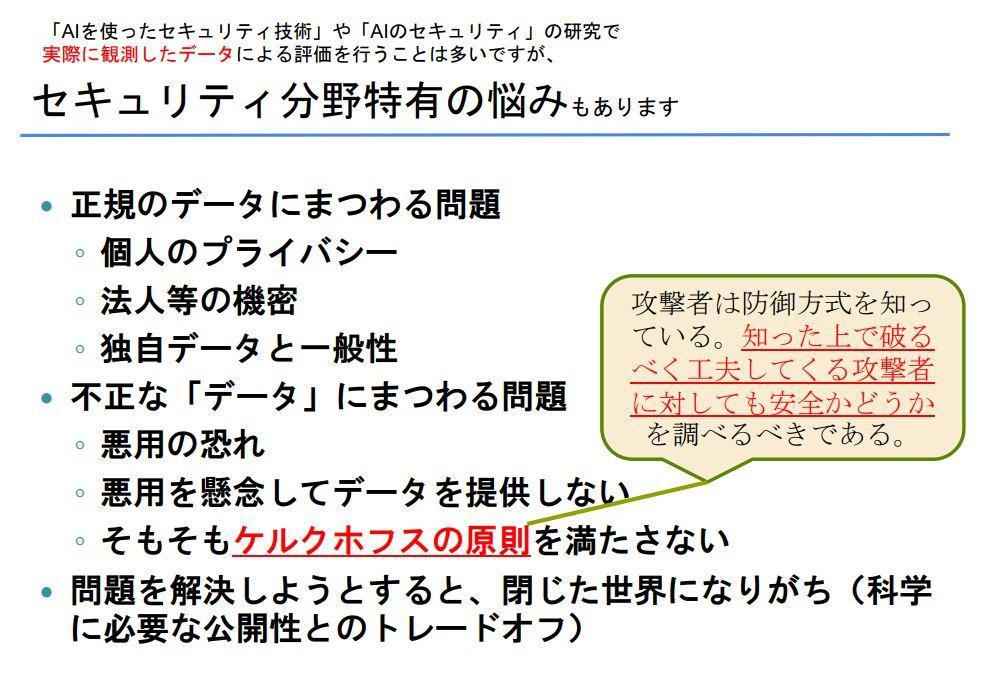

松浦教授は、セキュリティ研究特有の悩みをまとめたスライドも示しました。そうした悩みには個人のプライバシーへやデータの機密性への配慮といったよく知られているものから、ケルクホフスの原則を満たさないといった専門的なものもふくまれていました。この原則は「セキュリティ技術はその仕組みが知られても安全であるべき」というものです。しかしながら、未発表のサイバーセキュリティ技術を研究する場合、その技術を知っているのは研究者以外にはいません。それゆえ、その技術を知ったうえで行うサイバー攻撃に関するデータを用意できない、という一種のジレンマに陥るのです。

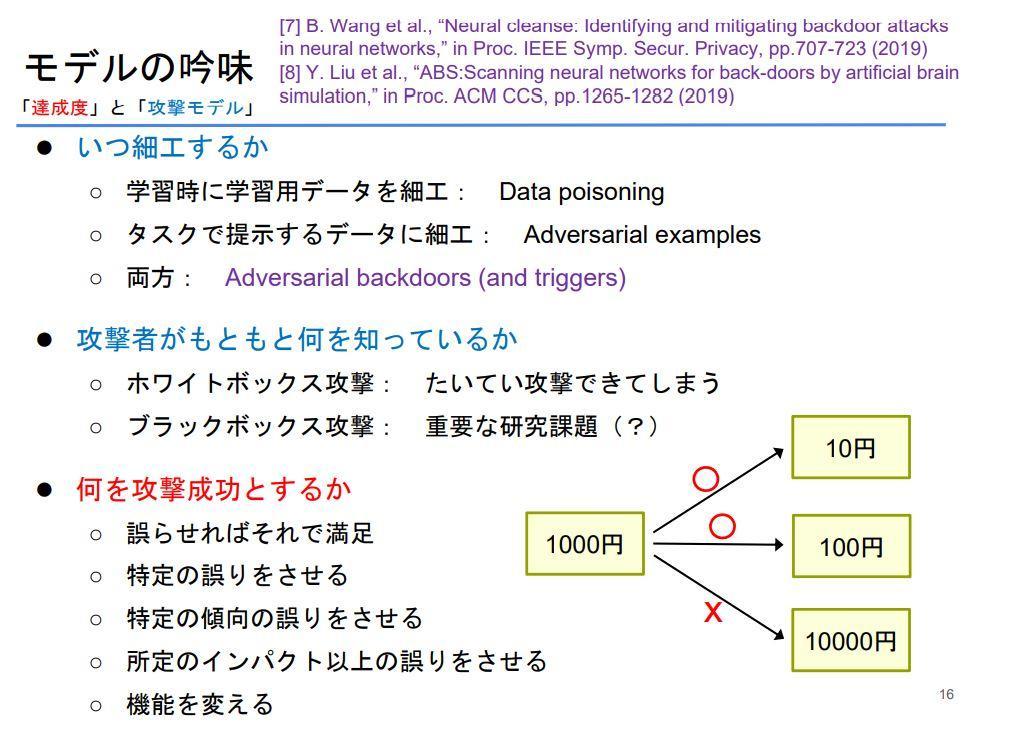

以上のような悩みをふまえたうえでインパクトのある研究を行う方針として、松浦教授はセキュリティシステムに実装するAIの防御能力を高めるモデルの吟味と、具体的な異常対応を実装することを挙げました。モデルの吟味に関しては、サイバー攻撃の標的が学習データあるいは出力データか、またはその両方かなどを明らかにするを「攻撃モデル」、そして攻撃内容の程度(何ができれば攻撃成功と見なすか)を明らかにする「達成度」という観点があります。

松浦教授は発表の締めくくりとして、長い歴史をもつサイバーセキュリティ研究について攻撃側が優勢のように語られることが多いが、防御側が優勢な時もある、と語りました。そして、防御側が優勢な時とは、システムの制約が防御側に有利に働く場合である、とも指摘して発表を終えました。

AI活用による「データ負けのスパイラル」からの脱却を目指して

2人目の登壇者である情報通信研究機構(NICT)所属の井上大介氏は、「AI×Cybersecurity – データ駆動型サイバーセキュリティ研究」と題してNICTにおけるAIによるデータ活用を組み込んだサイバーセキュリティの取り組みについて発表しました。

井上氏は、サイバーセキュリティにおけるデータの重要性を語ることから始めました。サイバーセキュリティ研究においては、過去と現在におけるサイバー攻撃に関するデータを調べることがあらゆる取り組みの土台となるため、「データが命」と言われます。しかし、データを集め分析するには非常に労力を要します。何らかの理由でデータを収集できていない状況が続くとサイバー攻撃の把握が進まないため、ますます攻撃に対して不利な状況に陥ります。こうした事態を同氏は「データ負けのスパイラル」と表現します。

つづいて井上氏は、NICTにおけるサイバーセキュリティ研究分野を紹介しました。同機構の研究は以下に示す画像のように横軸に無差別型攻撃対策か標的型攻撃対策か、縦軸に受動的か能動的かを意味する二軸マトリクスで4種類に分類できます。

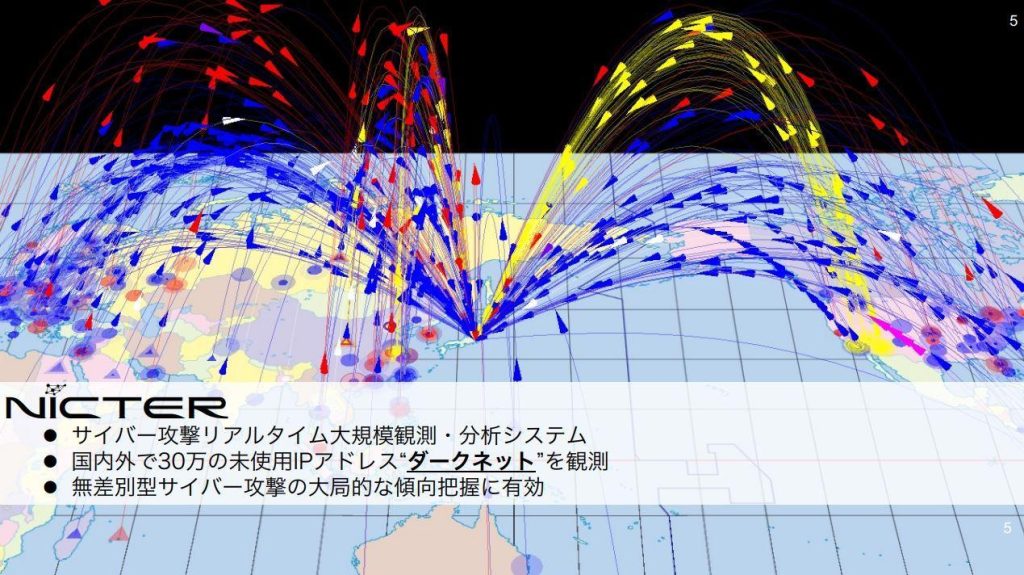

以上の4種類の研究のうち受動的な無差別型攻撃対策技術であるNICTERについて、井上氏はさらに説明しました。この対策技術は国内外のサイバー攻撃を観測・分析・可視化するものですが、そのシステムが動作する様子はまさにSF映画で描かれるようなものです。同システムの観測統計によると、1つのIPアドレスに対するサイバー攻撃は2021年には18秒に1回を記録し、近年ではIoT機器が攻撃対象となっています。

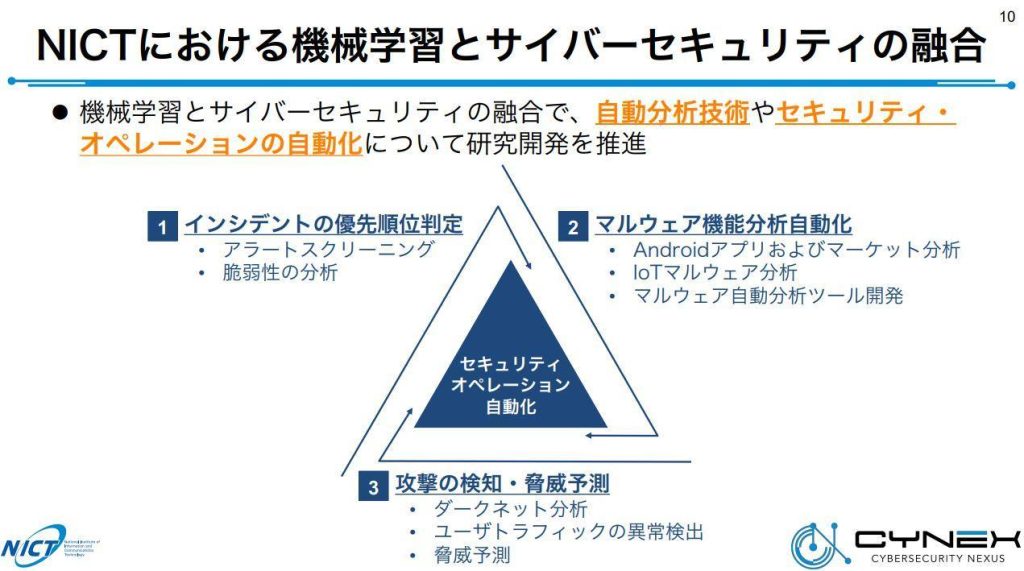

NICTのサイバーセキュリティ研究において、機械学習は以下の模式図で示されているように攻撃アラートのスクリーニング、マルウェアの機能に応じた自動分類、攻撃の早期検出に使われています。各応用事例における成果は、以下のようなものでした。

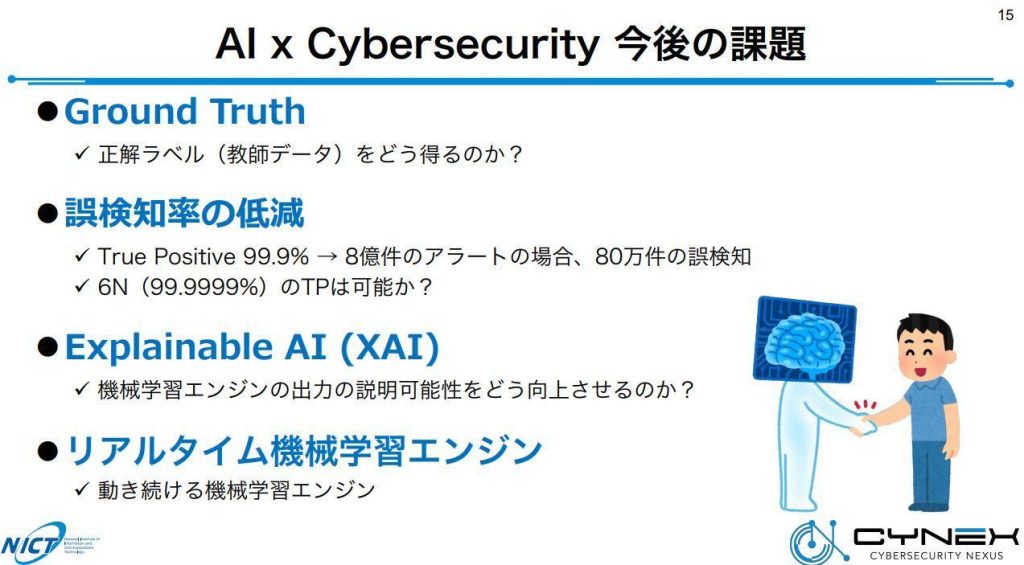

井上氏は、今後の課題として以下のスライドで書かれているような4項目を挙げました。このなかでも研究開発したセキュリティAIをリアルタイムに動作するエンジンとして実装することの重要性を強調しました。研究開発したAIは、実環境で連続的に問題なく動作することが最終目標となるのです。

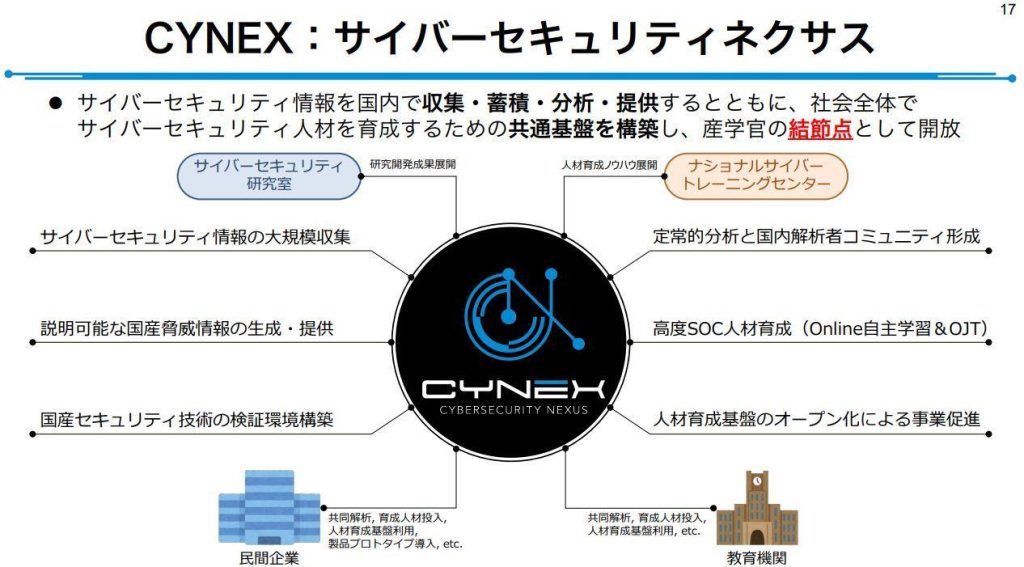

発表の最後に井上氏は、データ負けのスパイラルから脱却するための取り組みとしてサイバーセキュリティネクサスに言及しました。これは、データの収集と人材育成に関して産学官の結節点となるべく構築された組織です。同組織によって日本におけるサイバーセキュリティのデータと人材が集結して、この分野の研究開発が新次元に突入することが期待されます。

セキュリティ管理者をアシストするAIの開発

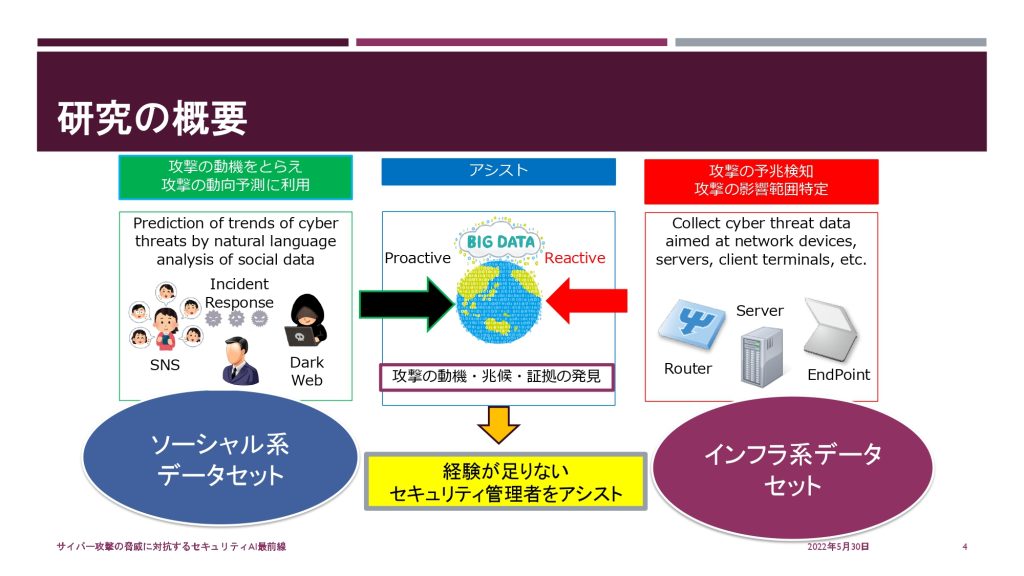

3人目の登壇者である東京大学情報セキュリティ教育研究センター(略称SIセンター)所属の関谷勇司教授は、「サイバー脅威検知と対策アシストへのAI適用」と題してセキュリティ担当者をアシストするAIの開発について発表しました。

はじめに関谷教授は、自身が所属するSIセンターにおける取り組みの概要を説明しました。サイバー攻撃が話題となる場合、しばしば未知の攻撃による被害が語られます。しかし、現実のサイバー攻撃のおよそ8割はすでに対策が確立されている既知のものなのです。にもかかわらず攻撃の被害に遭ってしまうのは、セキュリティ担当者に経験と知見が蓄積されていないからと考えられます。こうした現状を解決する方法として、SIセンターはセキュリティ担当者の経験や知見の不足を補うAIの開発に取り組んでいます。

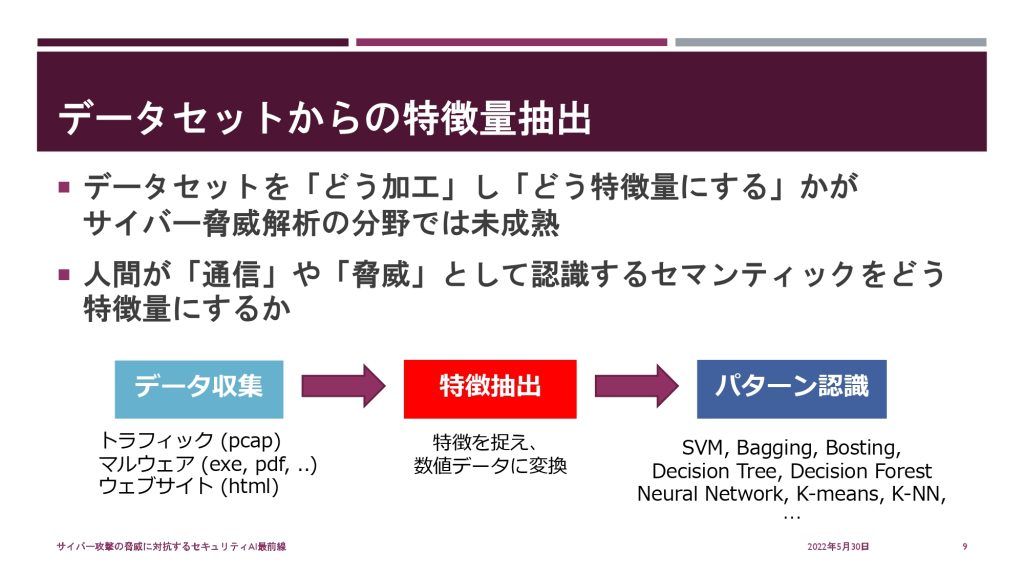

セキュリティ担当者をアシストするAIの研究事例として、関谷教授はサイバー攻撃によって生じた異常を検知するAIを挙げました。このAIの基本的な仕組みは、異常な状況に関するデータセットを収集したうえで異常時に顕著に表れる特徴を抽出した後、その特徴が観察された場合に異常と判定する、と説明できます。こうした異常検知AIを開発する際には、2つの問題に対処しなければなりません。具体的には学習データとなるデータセットに何を選ぶのか、また抽出すべき特徴に何を選ぶのか、という問題です。

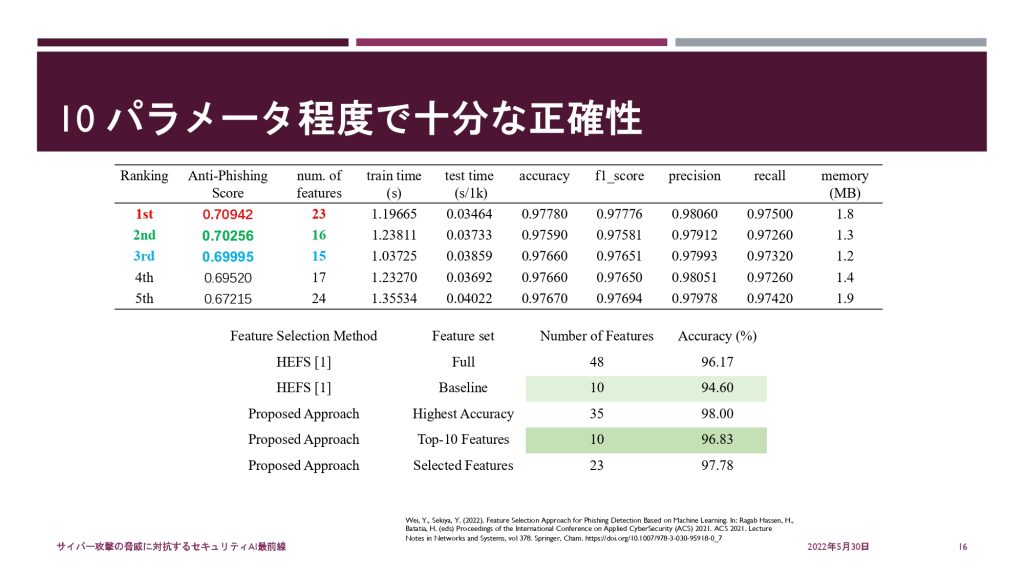

異常検知や悪性サイトの判定に際して注目する特徴として、関谷教授はSYNパケット、文字列、バイト列、さらには複数のパラメータを採用するといった事例を挙げました。同教授によると、最近の研究では10パラメータ程度で悪性サイトの検知には充分と報告されています。

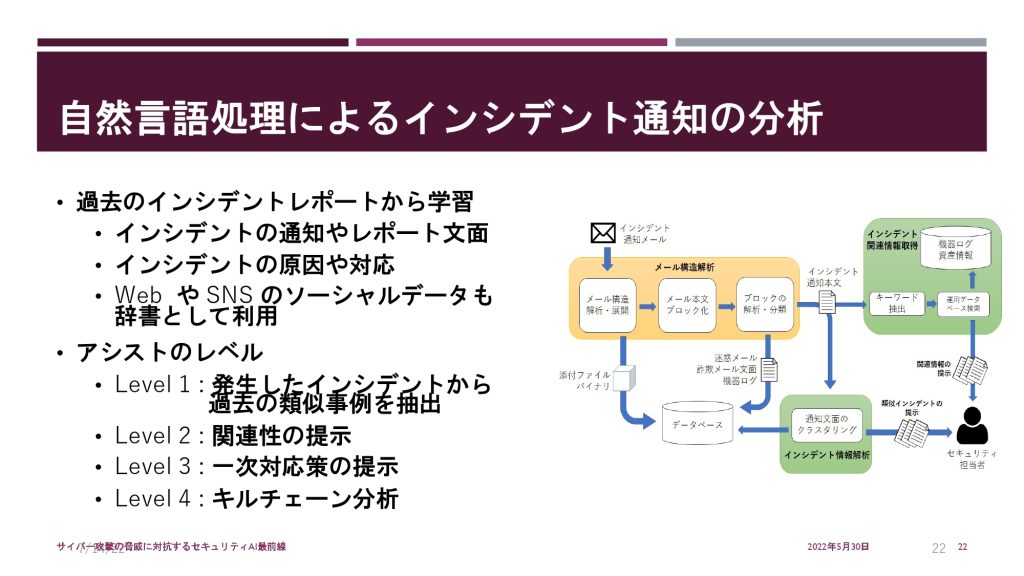

セキュリティ担当者をアシストするAIの研究では、自然言語処理を活用しているものもあります。そのような研究事例として、過去のインシデントレポートを使ってAIを訓練して、そのAIに任意のインシデントと類似した事例を抽出させたり、関連性を提示させたりするものがあります。そのほかにはSNSなどのソーシャルデータからサイバー攻撃の兆候を把握したり、文書中のトピックの出現確率を導出する自然言語処理であるLDA(Latent Dirichlet Allocation:潜在ディリクレ配分法)を用いてセキュリティ関連文書からデータセットを作成したりする取り組みもあります。

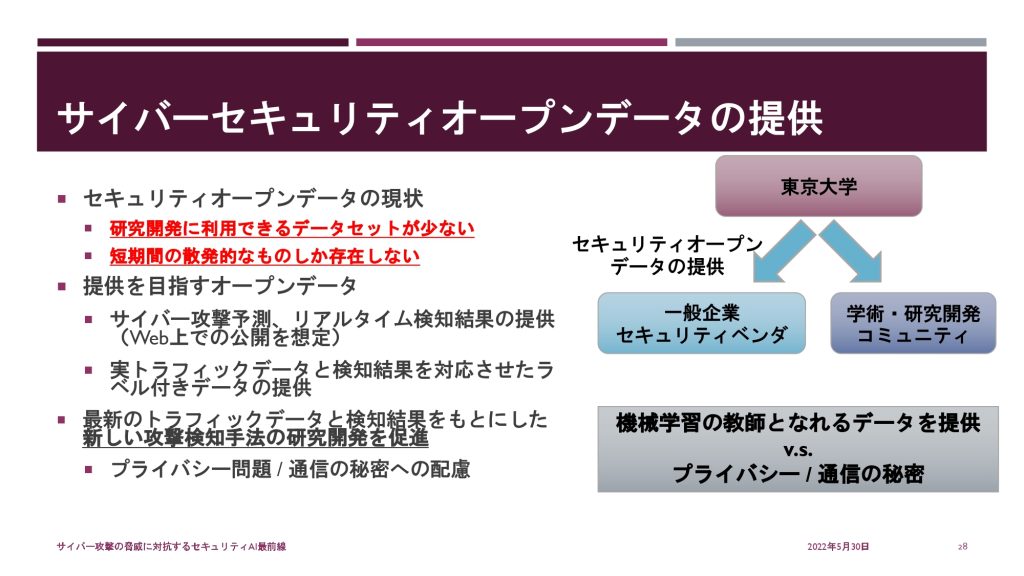

発表の最後に関谷教授は、SIセンターからサイバーセキュリティに関するオープンソースデータを一般企業や研究機関に提供する構想について語りました。サイバーセキュリティ技術の研究開発には良質かつ大量のデータが不可欠な一方で、データ提供時にはプライバシー保護や通信の秘密についての配慮が不可欠となることも補足しました。

信頼されるAIに求められる要件とその開発事情

4人目の登壇者である筑波大学システム情報系所属の佐久間淳教授は、「人間から信頼されるAIを目指して:AIセキュリティの観点から」と題して人間に信頼されるAIに求められる要件とその開発事情について発表しました。

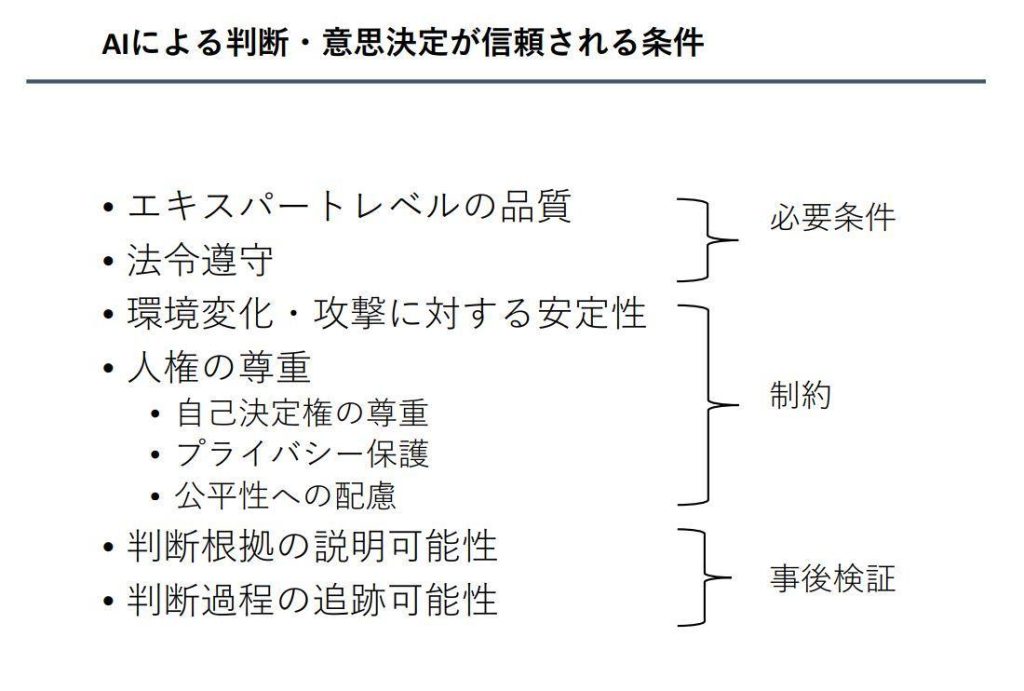

はじめに佐久間教授は、昨今のAIが画像認識のような特定のタスクに関して人間を凌駕する性能を発揮することをふまえると、近未来のAIには特定分野における専門家のような役割が期待されることを指摘しました。こうした期待にAIが応えるためには、単に高性能なだけではなく、法を守り必要に応じて納得の行く説明を行うことが求められます。同教授は、人間の期待に応えることで信頼されるAIの要件を以下のスライドのようにまとめました。

以上の信頼されるための要件のうち、セキュリティが関係するのは「環境変化・攻撃に対する安定性」です。

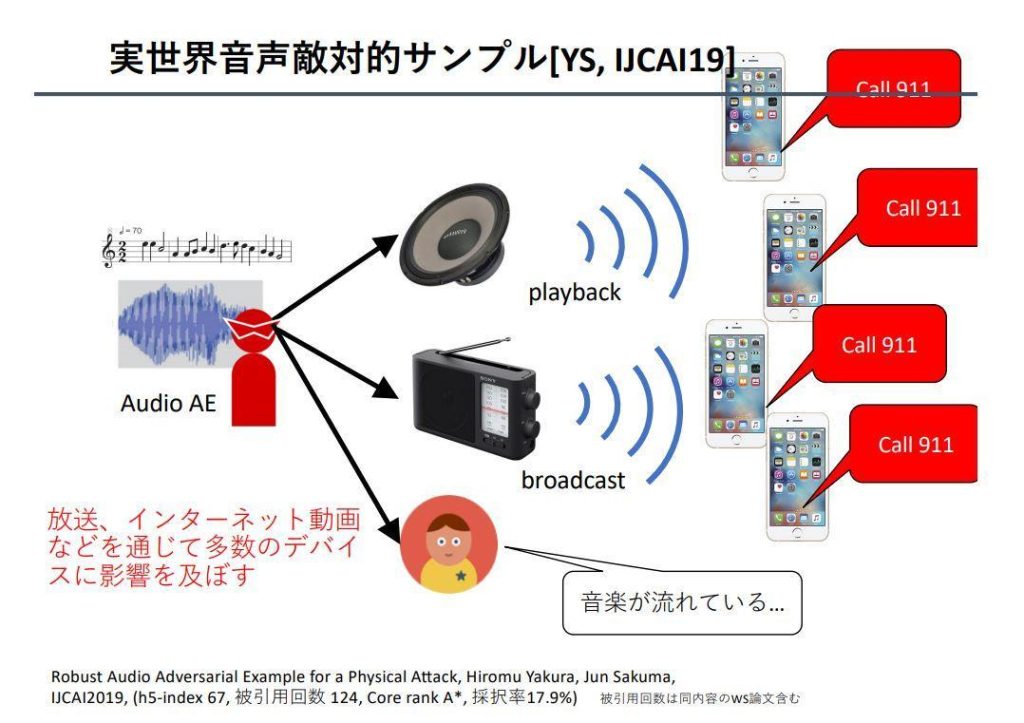

この要件で想定されているのは、すでに言及したノイズが混入しても正しく画像認識できるようなAIの堅牢性です。このようなデータ加工によるサイバー攻撃の事例として、佐久間教授は実世界音声敵対サンプルを挙げました。この事例は、音楽のような任意の音声情報に人間が識別できないような音声情報を加えたうえで、その追加情報により音声機器を不正に制御するというものです。同教授らの研究チームは、こうした実世界音声敵対サンプルの作成に初めて成功しました。

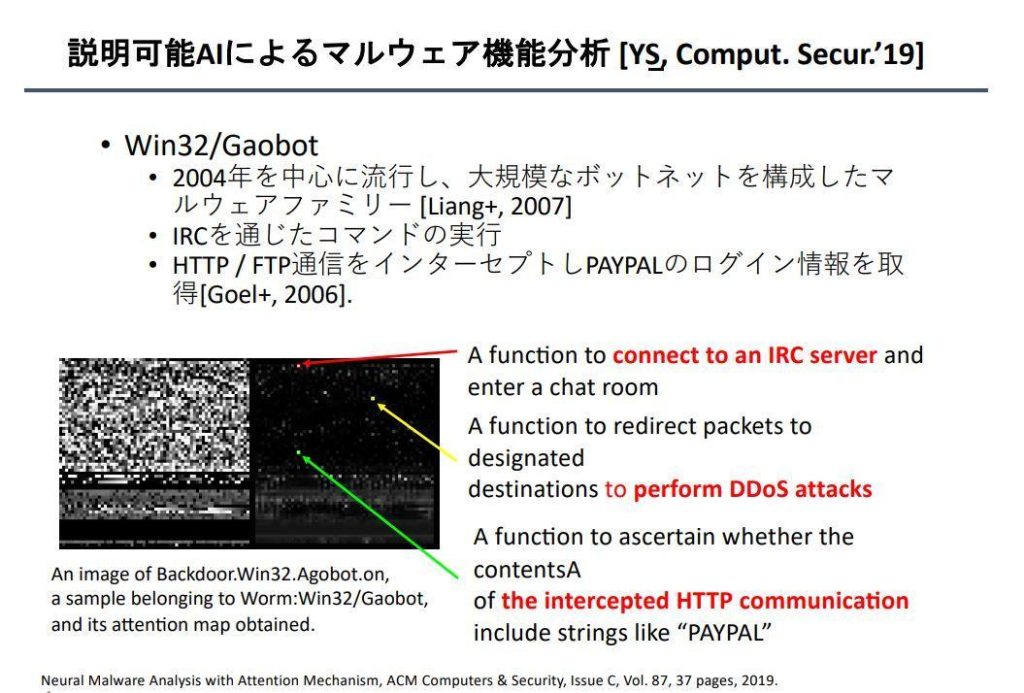

セキュリティ的観点から信頼されるAIのもうひとつの要件には、判断根拠の説明可能性があります。これはAIが下した判断について、人間に納得のいく理由を示さなければならないというものです。この要件については、マルウェアの機能を分析する際にその情報を画像化したうえで、画像に見られるどの特徴を注目したかを示すことで分析理由を提示するという研究があります。しかし、この研究では注目した箇所を示せても、なぜその箇所に注目したのかに関する理由を示せないという限界があります。

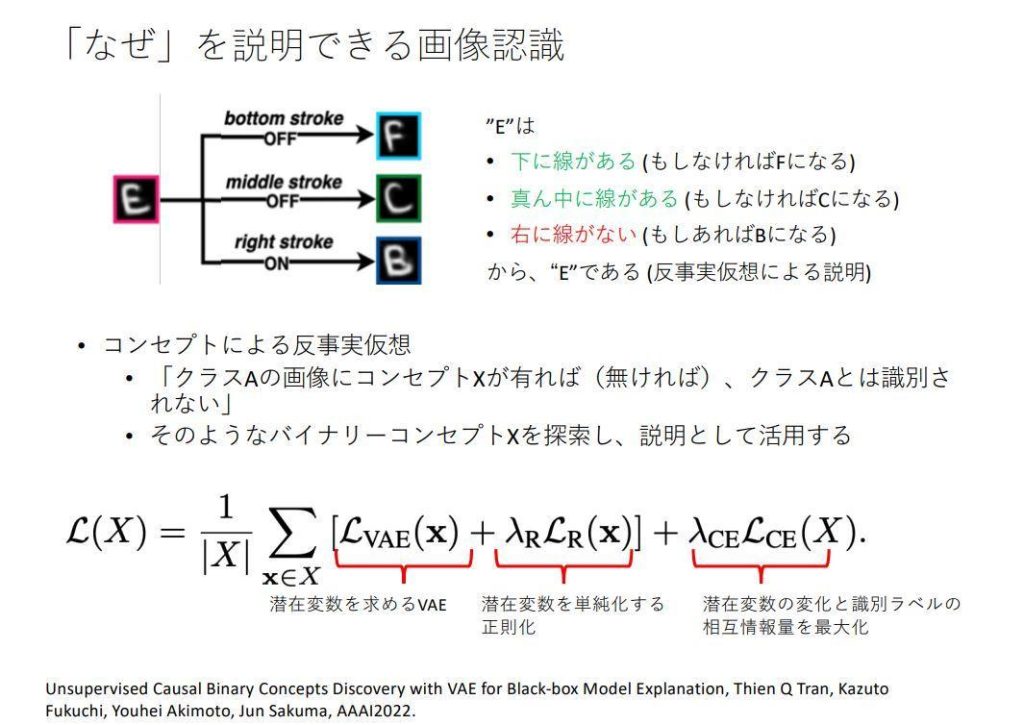

「説明可能なAI」というテーマで研究されている以上の要件について、佐久間教授らの研究チームは反事実仮想による説明を論じた論文を2022年のAAAIで発表しました。反事実仮想とは、例えばAIがある文字をアルファベットの「E」と認識した場合、「もし下線がなければFになる」というような事実ではないことを挙げたうえで、そうした事実が成立していないことからAIの認識が正しいと主張する論法のことです。こうした反事実仮想を積み重ねれば、納得の行く説明となると考えられます。

発表の最後に佐久間教授は、AIセキュリティにおけるIntegrityに言及しました。完全性とも訳されるこの概念は、改ざんなどの攻撃に対して仕様通りに情報処理されることを意味するセキュリティの3要素のひとつです(残りのふたつはConfidentialityとAvailability)。IntegrityをAIにあてはめた場合、敵対的環境下でも人間と同等な判断あるいは学習ができること、と同教授は考えています。この見解をさらに掘り下げて「AIによる判断根拠」が「人間による判断根拠」と矛盾しないことと敷衍すると、説明可能なAIの研究開発によってAIのIntegrityを実現できるのではないか、と同教授は自身の展望を語りました。

佐久間教授の発表後、登壇者4名にシンポジウム司会を務めたAIセンターの松原仁教授、さらにSIセンター長の中村宏教授がモデレーターとして加わってパネルディスカッションが行われました。ディスカッションで語られた興味深い見解の一部を箇条書きにすると、以下のようになります。

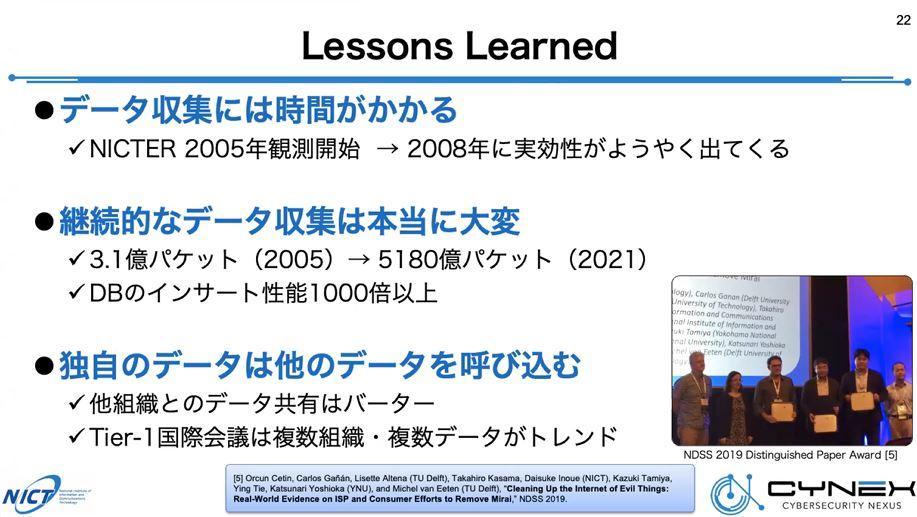

- (井上氏がスライドを提示しながら発言)データはある程度収集することではじめて実用的な価値が生まれる。NICTのNICTERは2005年からデータ収集を開始したが、2008年になってようやく日本国内の観測データが世界のそれと近い傾向を示すようになった。世界のトラフィックデータ量自体も増えているので、継続的なデータ収集は本当に大変である。

- (サイバー攻撃後の復旧対応について尋ねた松原教授の質問に対して佐久間教授が回答)ディープラーニングのような複雑なシステムでは、攻撃を受けた時にその影響を完全に取り除くのは困難と考えられる。

- (「サイバーセキュリティをめぐる攻撃と防御のいたちごっこを終わらせる手立てはないのか」というシンポジウム視聴者からの質問に対して松浦教授が回答)サイバー攻撃の被害を金銭コストに換算して評価する研究が2001年頃からある。しかし、世界的に普及するような汎用的な評価手法(セキュリティ保険)は確立されていない。サイバー被害のコスト換算においてイノベーションが起これば、そのインパクトは大きいだろう。

- (「最新のサイバー攻撃トレンドに関する情報収集方法にはどんなものがあるのか」という司会の塚田氏の質問に対して関谷教授が回答)国家単位でサイバーセキュリティ情報を収集している国はあり、日本ではNISCやNSC(日本版国家安全保障会議)が該当。こうした組織がデータを有効活用しているかと言えば、疑問。研究者はデータを共有したいが、実務者はデータ共有に恐怖を感じる。というのも、データを共有すると、見られたくない情報も見られるリスクがあるから。

- (「今後優先的に取り組みたいことは何か」という中村教授の質問に各登壇者が登壇順に回答。はじめに松浦教授が回答)セキュリティシステムの難しさについて「部品が完全でもシステムは完全ではない」と言われることがある。その一方で、部品が弱くてもシステムも弱いとは限らない、言い換えれば低コストで強いセキュリティシステムを構築する方法もある。セキュリティの高度化とコスト的現実性を両立した研究を目指したい。

- (井上氏)データ分析に関してAI研究者とコラボできれば世界に対する日本のアドバンテージを確立できるのはないか、と思っている。

- (関谷教授)サイバーセキュリティへの投資は安全確保のための投資であり、何かを生み出すものではない。ゆえに、なかなか一般の人々にその重要性を理解してもらえない。こうしたなかでサイバーセキュリティを確保できなければ社会が成り立たないことを教育によって学生に伝えたい。また、通信の秘密を保障しながらサイバーセキュリティ関連データの共有を推進したい。

- (佐久間教授)AIを活用したサイバーセキュリティはまだ新しい研究分野。この分野の研究者のモチベーションは、AIが改善できることにある。一方でセキュリティ技術である以上、現実における脅威に対応していかなければならない。AIを直接的な攻撃対象にしたサイバー攻撃は、まだ少ないと考えている。そうした事例を知っている実務家と連携したい。

サイバーセキュリティ技術の研究開発は、次々と新手の攻撃が出現することから終わりのない営みと言えます。終わりがないのは研究者が無力だからなのではなく、サイバー攻撃を含めた犯罪行為が人類社会から撲滅できないというより根源的な理由にも因ります。こうした終わりなき戦いにおいて、大量のデータを処理できるAIは強力な新戦力としてその活用が研究され続けるでしょう。

Writer:吉本幸記