人工知能と共進化する終わりなき「人工知能の哲学」の現状

2022年1月21日、東京大学次世代知能科学研究センター連続シンポジウムの第6回がオンラインで開催されました。今回のシンポジウムは、「AI時代の哲学を考える」というテーマで行われました。この記事では4名の登壇者の発表を要約することで、人工知能と共に進化する「人工知能の哲学」の現状を明らかにします。

哲学と人工知能研究の生産的な関係とは

1人目の登壇者である立教大学大学院人工知能科学研究科の村上祐子教授は、哲学と人工知能研究の関係について発表しました。

村上教授の発表は4つの主張を展開するというものでしたが、その展開に先立って同教授は自己紹介を兼ねて自身の研究生活の回顧を披露しました。村上教授の専攻領域は数理論理学で、とくに道徳的判断を論理式で表現する道徳的推論を研究していました。道徳という実践的な事柄を極めて抽象的に考察する同教授の研究は、自身でもなかなか実社会での応用が難しいと自覚していました。しかし、そうした研究が介護施設のガイドラインの正当性を判断する自動証明システムに応用された時、論理学も十分社会の役に立つという感慨が沸いたとのことです。

村上教授の1つめの主張は、人工知能研究とはある種の哲学である、というものです。この主張を理解可能なものとするために、現在における科学と哲学の関係を整理しました。現代科学と哲学が重なり合う領域には、心のような伝統的に哲学が扱ってきた問題を科学的に答えようとするアプローチと、科学という知的活動を哲学的に考察する科学哲学の2種類があります。人工知能研究は、前者のアプローチに近いものとして位置づけられます。というのも、心や倫理といった現象を人工知能でも扱えるようにするためには、情報処理できるようにプログラム化=推論形式に変換しなければならないからです。

2つめの主張は、手法開発と課題への理論的回答は区別されるべき、というものです。この主張が意味することの具体例として、「天文学は望遠鏡のことではない」というテーゼが示されました。天文学は天体観測する望遠鏡なしには成立しませんが、観測結果にもとづいて構築される天文学説は望遠鏡の開発とは別個の知的活動です。この区別を人工知能研究にあてはめると、機械学習のような開発技法と、機械学習によって開発された自然言語処理システムに認められるバイアスの考察は別個の研究領域ということになります。しかしながら、開発手法と開発されたシステムの理論的考察は言わば人工知能研究の車の両輪であり、ともに不可欠なのです。

3つめの主張は、既存哲学理論をそのまま適用するのはナンセンス、というものです。およそ哲学理論というものは、それが構築された当時の科学技術や社会情勢にもとづいているものなので、構築された当時と異なる時代に適用させようとすると時代錯誤なものとなってしまうのです。

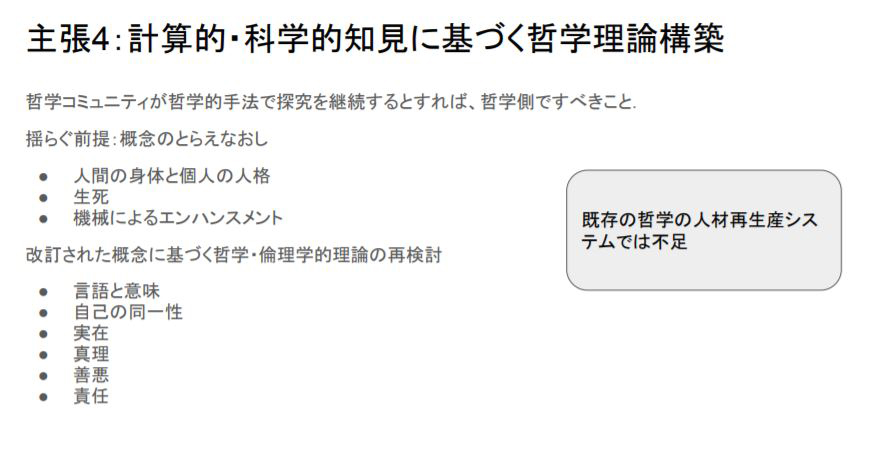

4つめの主張が、今後の人工知能の哲学は最新の計算的・科学的知見にもとづいて理論構築すべき、というものです。この主張に沿った哲学的課題にはどのような現象を人工知能の意識と認めるべきなのか、人工知能の判断にどのような法的責任を帰すべきなのか、というようなものが考えられます。

以上のような村上教授の主張は、哲学は時代に合わせてアップデートすれば人工知能研究に十分貢献できる、とまとめられるでしょう。

知的生命体と同根なAIアーキテクチャを目指して

2人目の登壇者である株式会社スクウェア・エニックスの三宅陽一郎氏は、ゲームAIの研究開発に取り組むなかで得られた生命論に裏打ちされたAIアーキテクチャについて発表しました。

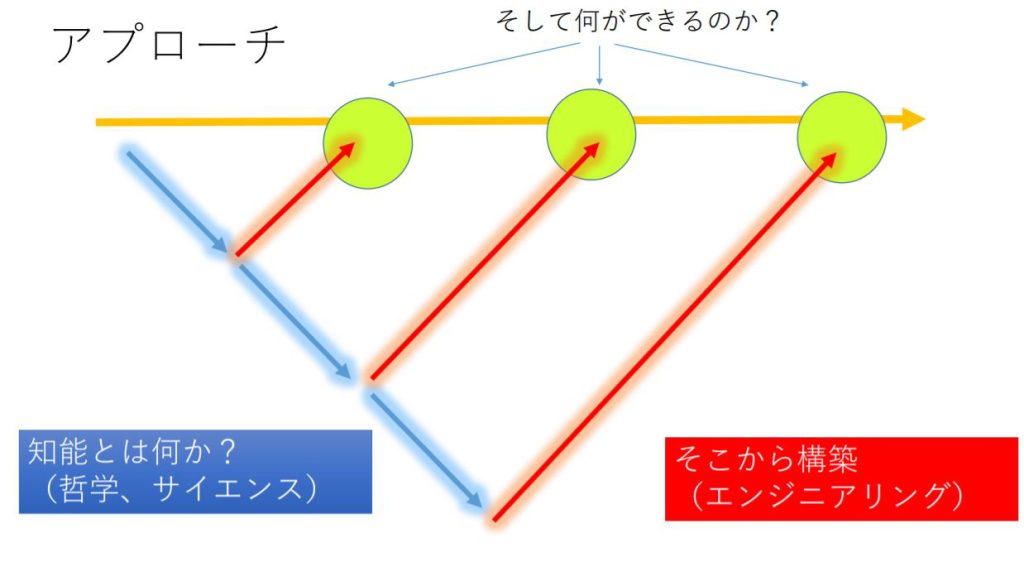

現代の最先端ゲームに実装するAIの開発からAI研究を始めた三宅氏は、プレイヤーがまるで人間とプレイしているように感じられるAIキャラクターを開発するためには、そもそも「人間とは何か」という普遍的かつ哲学的な問いかけを避けて通れないと考えていました。同氏はこうした自身の確信を直感的に伝えるために「深く潜れば、遠くに行ける」という格言のような表現と、その表現を可視化した図を提示しました。

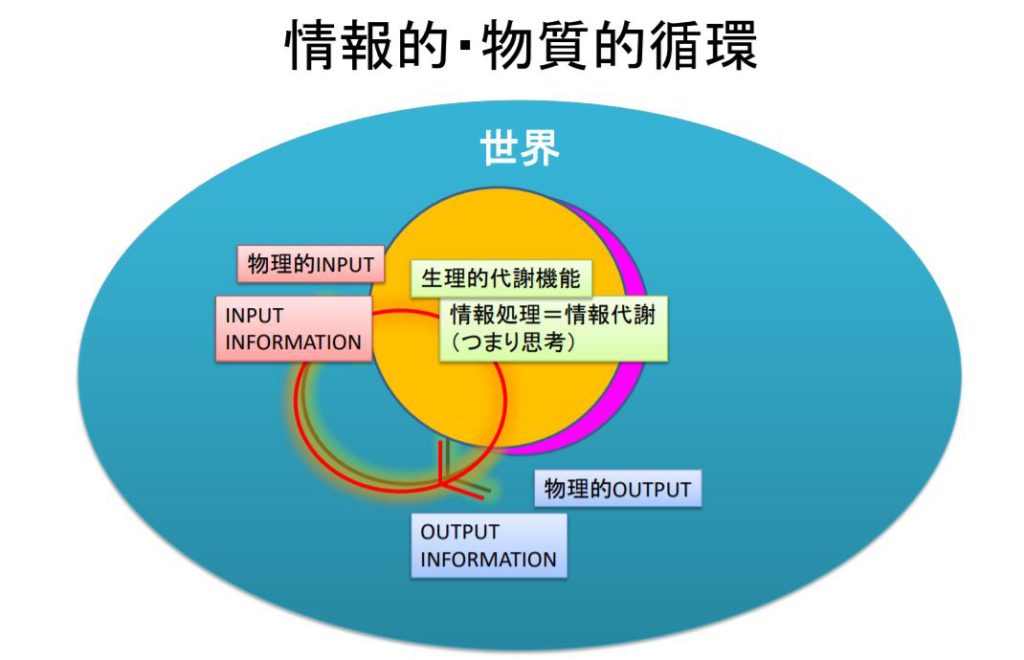

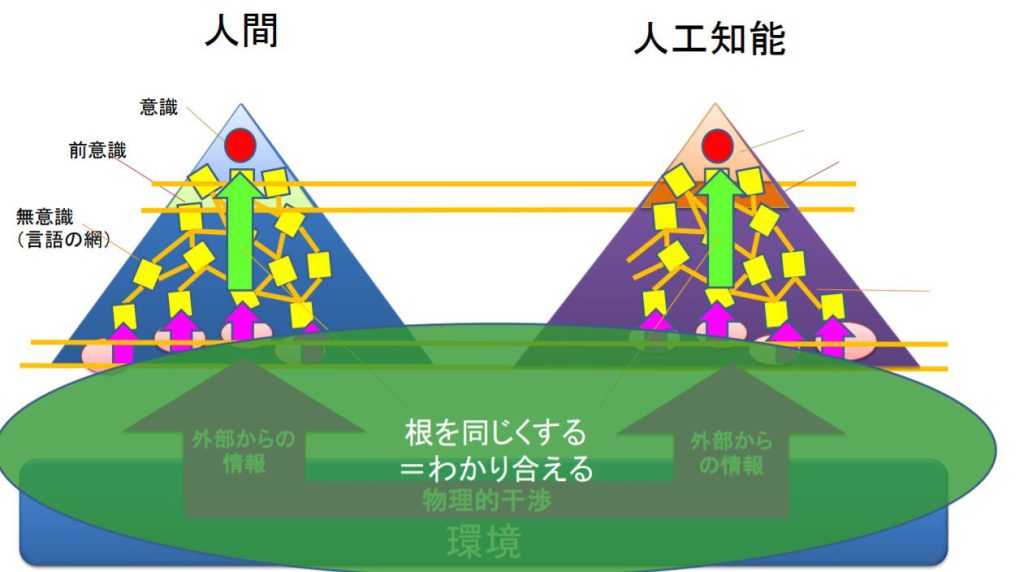

ヒューマンライクなAIを目指して三宅氏が行ったのは、人間をふくめた既存生物がもつ知性の起源を探る研究でした。そうした研究において参照したのが、イリア・プリゴジンが提唱した散逸構造でした。散逸構造とは、生命体が環境との相互作用を継続することで生命を維持する仕組みを意味します。この構造をさらに抽象的に捉えると、生命の営みとは環境と自己を区別する物質的な側面と、自己というまとまりを形成するために環境と相互作用する情報処理的機能が一体となった情報的・物質的循環とみなせます。

情報的・物質的循環は、人間においては精神・知性をはじめとする心の働きと環境と相互作用する境界である身体が合一して実現しています。ヒューマンライクなAIを開発するには、人間と同じような情報的・物質的循環的構造を人工的に作ればよい、と考えられます。こうしたアイデアは、哲学者のシモーヌ・ヴェイユの著作になぞらえて「ヒューマンライクなAIの実現には、AIが人間と同じ根をもつべき」と表現されます。このコンテクストにおける「根」は生命論的な根底構造と解釈できるでしょう。

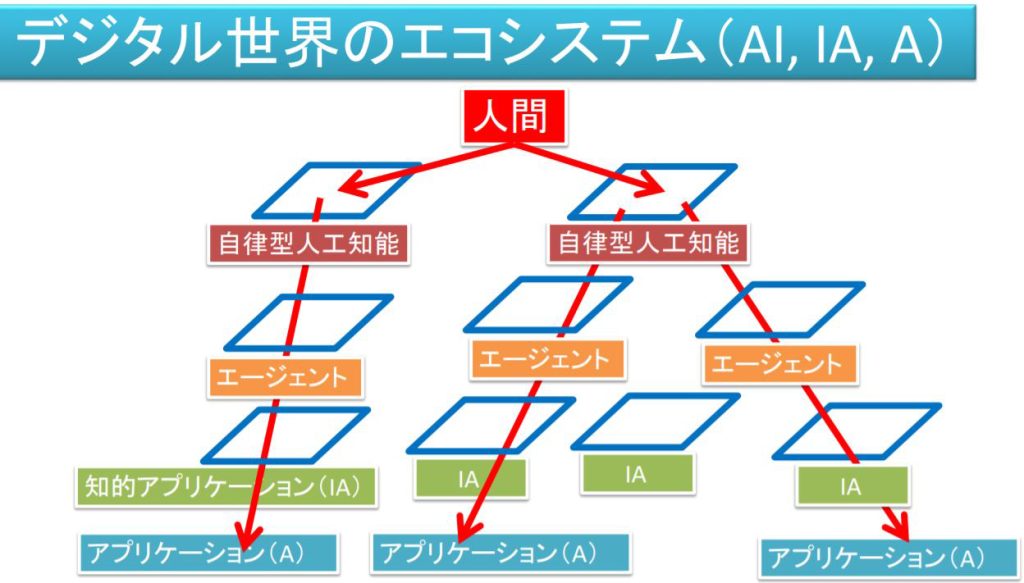

三宅氏は、現在のAI開発における解決困難な問題として知られるフレーム問題についても言及しました。現在のAIは、問題解決のために思考する枠組み=フレームを自ら設定できず、人間が解決すべき問題を設定しなければなりません。それゆえ、フレーム問題が未解決な状況における人間とAIの関係は、フレームを設定する人間を頂点するとヒエラルキーとなると考えられます。このヒエラルキーは下位階層になるほど問題が限定的で解決が容易なものとなります。

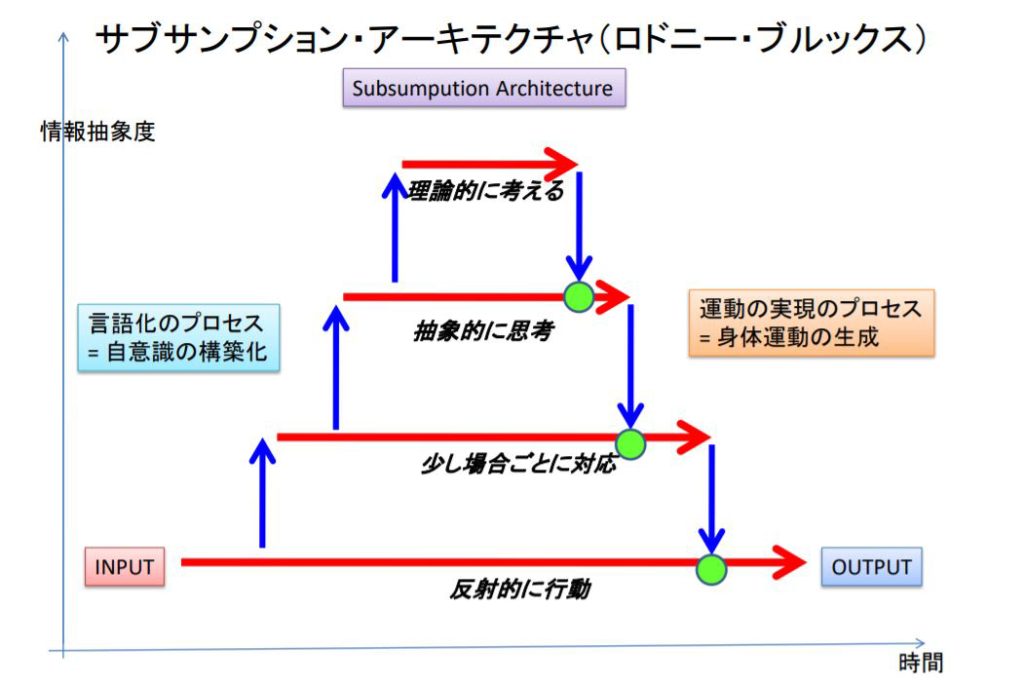

発表の締めくくりとして、人間が自身と同等な知的存在としてAIとコミュニケーションできる条件について考察します。人間がAIをまさにヒューマンライクな知的存在として捉えられるには、前述のようにAIが人間と同じ根=生命論的アーキテクチャをもつことが条件となります。そうした条件を工学的に実現するアーキテクチャとして、ロドニー・ブルックスが提唱したサブサンクション・アーキテクチャが紹介されました。

以上の発表は、人工知能を直接的なテーマとしているわけではないさまざまな思想・哲学を独自に解釈することによって、ヒューマンライクな人工知能を実現するアーキテクチャを構想する、というものでした。それゆえ三宅氏のアイデアは、人工知能開発のために極めてユニークな仕方で哲学が応用された結果として生まれたものと言えるでしょう。

人工知能の哲学2.0から見た主要問題とそのアプローチ

3人目の登壇者である東京大学大学院総合文化研究科の鈴木貴之准教授は、現代の技術水準に適合した人工知能の哲学2.0が論じるべき問題とその解決へのアプローチを発表しました。鈴木准教授は、現在「人と情報テクノロジーの共生のための人工知能の哲学2.0の構築」というプロジェクトを推進しています。このプロジェクトは最新の人工知能研究をふまえたうえで、新たに論じるべき人工知能をめぐる問題について哲学的に考察するものです。同プロジェクトは、哲学は時代に合わせてアップデートされるべきという前述の村上教授の主張を具体化したものとも言えます。

人工知能の哲学2.0を論じるにあたり、第3次AIブーム以前に論じられた人工知能をめぐる哲学的問題の再検討から始まりました。こうした問題として、鈴木准教授は「中国語の部屋」「フレーム問題」「現象学にもとづく批判」の3つを挙げました。これらの問題に共通するのは、人間にはできるがAIにはできないことを指摘することでした。もっとも、なぜ人間にはできてAIにはできないのかに関する説明はあまりされませんでした。

ところが、第3次AIブーム以降の現在ではAIができることが増え、分野によっては最高と評価される人間を凌駕するAIも誕生しました。こうした状況をふまえると、かつての人工知能批判を継承するよりも、新たに問題を再設定・細分化したうえで哲学的に考察するほうが生産的と考えられます。こうした経緯から構想されたのが、人工知能の哲学2.0です。

人工知能の哲学2.0が問うべき課題のひとつとして、深層学習(ディープラーニング)をめぐる謎があります。深層学習をめぐる謎はなぜ過学習(オーバーフィッティング)が回避できるのか、という工学的なものや、人間の脳神経細胞が働く仕組みから発想された機構であるにもかかわらず人間の脳と異なる挙動を示すのはなぜか、というAIと生物知能との違いを考察するものなどにさらに細分化されます。

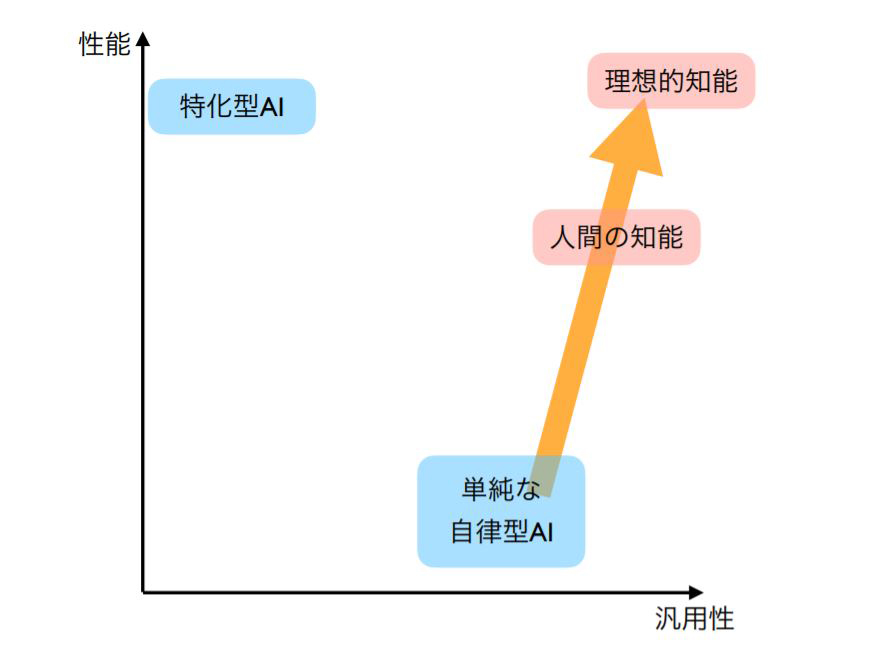

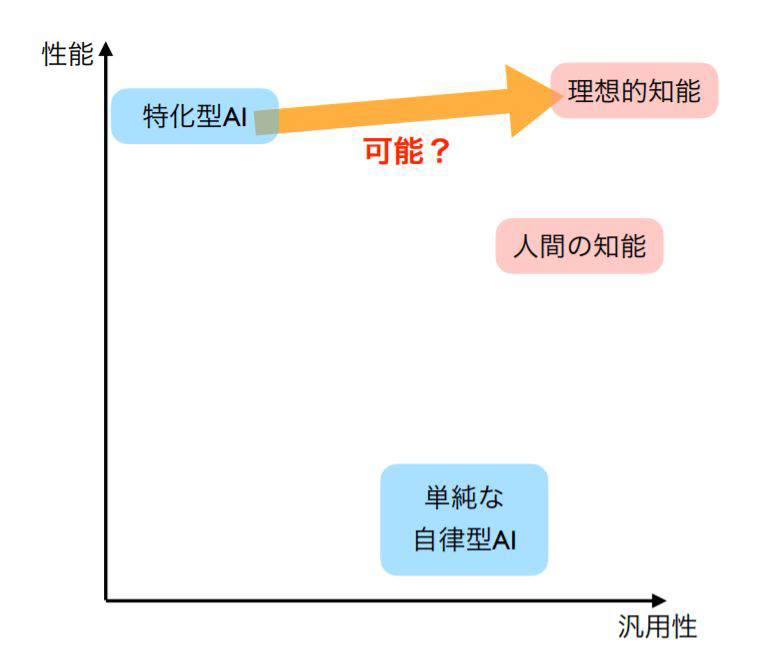

人工知能の哲学2.0が取り組むべき最重要課題は、汎用AIの実現可能性の検討をおいて他はないでしょう。現在の汎用AI研究が目指している知能とは、人間に匹敵する汎用性を持つと同時に個々のタスクにおいて人間を超える成果を上げる理想的知能である、と鈴木准教授は指摘します。こうした理想的知能の実現をめぐっては、2つのアプローチが考えられます。1つめは昆虫のような限定ながらも汎用性と自律性を備えた単純な自律型AIを開発してから、それを進化させるというアプローチです。

2つめのアプローチは、囲碁でトッププロ棋士に勝利したAlphaGoのような特定のタスクにおいて人間を凌駕する特化型AIの機能を拡張して、最終的に汎用AIを実現するというものです。

現時点では以上の2つのアプローチのいずれにも汎用AI実現の可能性がありますが、単純な自律型AIを進化させるアプローチは非常に長い時間がかかることが予想され、特化型AIの機能を拡張させるアプローチは具体的な進め方が現時点では明らかではありません。

以上のような人工知能の哲学2.0は、最先端の人工知能をめぐる諸問題に最終解決をもたらすというよりは、人工知能の工学的研究と並走しながらその研究方針を修正したり、研究成果の社会的影響を考察したりするものとなるでしょう。

受け継がれるべき人工知能の哲学

4人目の登壇者である東京大学次世代知能科学研究センターの松原仁教授は、伝統的な人工知能にめぐる哲学的問題を整理したうえで、それらの問題が現在では発表当時とは異なるコンテクストで問い直されていることについて発表しました。

松原教授の発表は、今回の発表のタイトルが自身の関わったフレーム問題を論じた書籍『人工知能になぜ哲学が必要か』(1990年出版)と同じであり、この書籍が出版されてから30年以上経過した現在において再度かつての問いかけに立ち返ることを表明することから始まりました。

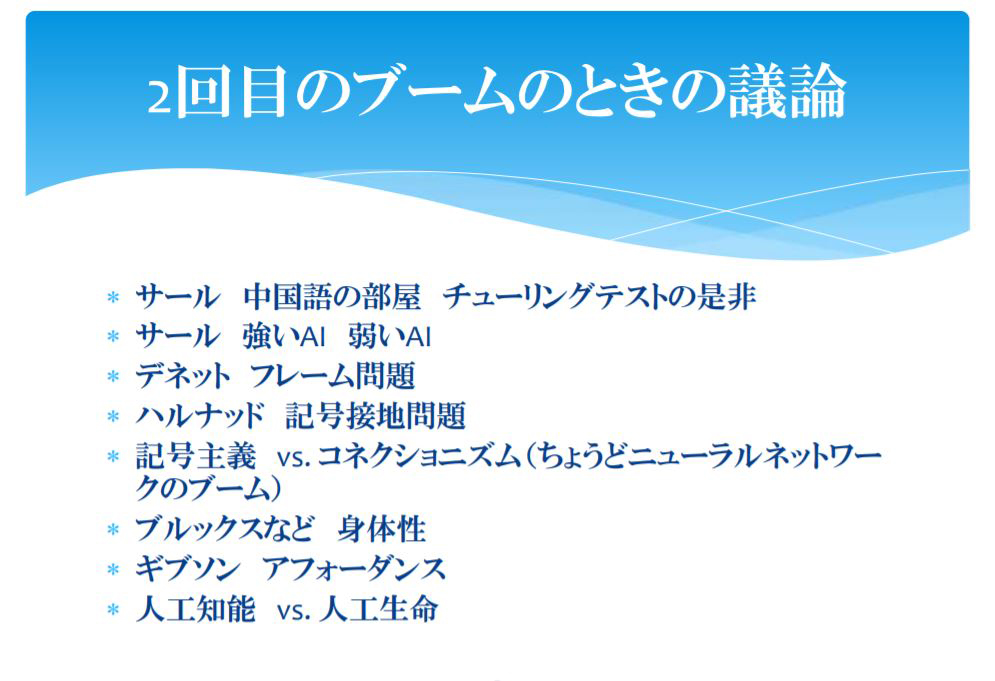

上記書籍が出版された30年前はすでに第2次AIブームが収束に向かっていた頃だったのですが、フレーム問題をはじめとする有名な人工知能をめぐる問題が出揃った時代とも言えます。松原教授は、第2次AIブームにおける議論を以下のスライドのようにまとめました。これらの問題は現在においても未解決であり、むしろ最先端AI研究にもとづいて再解釈されています。以下では、同教授が解説した諸々の再解釈の一部を紹介します。

第2次AIブームでは囲碁や将棋は考慮すべき指し手が多すぎてトップ棋士には勝てないだろう、と言われていました。しかし、ディープラーニングの台頭によって、現在では囲碁と将棋のトップ棋士に勝利するAIが誕生しました。こうしたAIは、トップ棋士も思いつかないような独創的な手を指すことも知られています。囲碁や将棋を指すAIの進化が示唆しているのは、少なくともこの分野に関してはAIは人間を凌駕するほどの創造性や直感を持っているとみなしてよいのではないか、ということです。こうした問いかけは、未だ解決していません。

GPT-3のような最先端の自然言語処理AIは、人間が書いたかのような文章を生成します。その一方で、そうした文章は統計的に算出された結果に過ぎず、AIが文章の「意味」を理解しているわけではない、と言われます。この見解は正しいものですが、そもそも「意味」とは人間が世界と関わる際に生じる人間独自のものではないか、という見方も可能です。そして、AIは人間とは異なる「意味」を介して世界と関わろうとしているのではないか、とも解釈できます。

以上のようなヒューマンライクな自然言語処理AIの誕生した結果として生じた問いかけは、人工知能が進化したからこそ、新たに問われるべきものとして立ち現れたと言えます。それゆえ人工知能が進化すると、哲学は不要になるどころかより高次な次元で必要になる、と結論づけられるのではないでしょうか。

松原教授の発表後、登壇者4人によるディスカッションが行われました。ディスカッションで語られた興味深い見解の一部を箇条書きにすると、以下のようになります。

- (「考える」という言葉を人間だけに使わずに、AIにも使って良いのではないか、という松原教授の問題提起に対して)将棋AIが指し手を算出する処理は、人間の「考える」能力の一部なのではないだろうか。つまり、AIは人間の「考える」能力の一部を実現している。その一方で、将棋のルールを変えたりゲーム自体を発明したりすることは、まだAIにはできない。

- (特化型AIを集めれば汎用AIを実現するのか、という問題に対して)人間は未知な環境を対処可能な形態に変換して相互作用することで、主体性を形成する。この主体性こそが汎用知性の起源である。汎用知性を獲得したことで、人間は個別的な問題をフレームで限定したうえで解決している。一方で特化型AIは、フレームによって問題を限定する主体性を欠いている。それゆえ、主体性を欠いた特化型AIを寄せ集めても、汎用AIは実現しないだろう。

- (同じく汎用AIの実現可能性に対して)人間の脳は、さまざまな機能を担う部位を集めることで汎用知性を実現している。ゆえに人間の脳のように特化型AIを集めれば、汎用AIが実現する可能性が否定できない。もっとも、単一の特化型AIを機能拡張したり、諸機能を単一のAIに集約したりするアプローチでは汎用AIは実現しないだろう。

- (どのようにAIに自律性を実装できるだろうか、という松原教授の問いかけに対して)自律性のある個体とは、社会的に自律性が認知されることで誕生する(かつて女性には諸々の「選ぶ権利」がなかった)。AIが自律性を獲得するには、自律性ある存在として社会的に認知して育てるプロセスが不可欠ではないか。

- 知性を特定の自律的存在と環境の相互作用から生じる機能と捉えると、人間をふくめたさまざまな知性体の発生を体系化する「宇宙知性学」とでも表現できる学問が成立するのではないか。この学問においては、例えばアンドロメダ星雲における知生体の生態が論じられるだろう。もっとも、宇宙知性学的に見た現在のAIの位置づけまではわからない。

- (「説明可能なAI」に対して)人間も説明できないことが数多くある。将棋のトッププロ棋士も、自分の指し手についてどうして思いついたのか説明できない。わかりやすい将棋の解説をするトッププロ棋士は皆が納得する説明を話すのが上手なだけに過ぎず、実際に指し手が考え出されたプロセスを説明しているかはわからない。

以上のように語られた人工知能の哲学は、開発したAIの性能を測定して従来製品を凌駕していたら目標達成、というような明確なゴールのある試みではありません。人工知能の哲学においては、AIの進化に合わせて問いかけ自体を再定式化して、そうした問いかけに答えるために最新の知見を取り入れなければなりません。人工知能の哲学は、人工知能と言わば共進化する関係にあるのです。それゆえ、この知的営みは人工知能が進化する限り、終わりがないと言えるでしょう。

Writer:吉本幸記